Un hombre con una discapacidad grave del habla puede hablar expresivamente y cantar gracias a un implante cerebral que traduce su actividad neuronal en palabras casi instantáneamente. El dispositivo transmite cambios de tono cuando hace preguntas, enfatiza las palabras que elige y le permite tararear una serie de notas en tres tonos. El sistema, conocido como interfaz cerebro-computadora (ICC), utilizó inteligencia artificial (IA) para decodificar la actividad cerebral eléctrica del participante mientras intentaba hablar. El dispositivo es el primero en reproducir no solo las palabras que una persona pretendía decir, sino también características del habla natural como el tono, la altura y el énfasis, que ayudan a expresar significado y emoción.

Nuevo implante

En un estudio, una voz sintética que imitaba la del participante pronunció sus palabras en 10 milisegundos tras la actividad neuronal que indicaba su intención de hablar. El sistema supone una mejora significativa respecto a los modelos BCI anteriores, que transmitían el habla en tres segundos o la producían solo después de que los usuarios terminaran de imitar una frase completa. “No siempre usamos palabras para comunicar lo que queremos. Tenemos interjecciones. Tenemos otras vocalizaciones expresivas que no están en el vocabulario”.

“Este es el santo grial de las BCI de voz”, afirma Christian Herff, neurocientífico computacional de la Universidad de Maastricht (Países Bajos), que no participó en el estudio. “Ahora es habla real, espontánea y continua“.

El participante del estudio, un hombre de 45 años, perdió la capacidad de hablar con claridad tras desarrollar esclerosis lateral amiotrófica. Se trata de una enfermedad de las neuronas motoras que daña los nervios que controlan los movimientos musculares, incluidos los necesarios para el habla. Aunque aún podía emitir sonidos y pronunciar palabras, su habla era lenta y confusa.

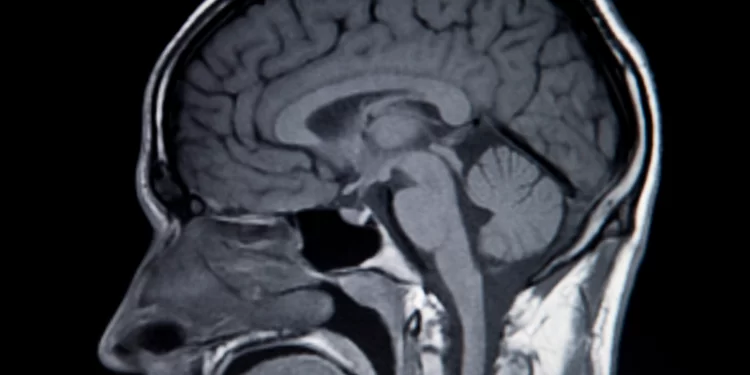

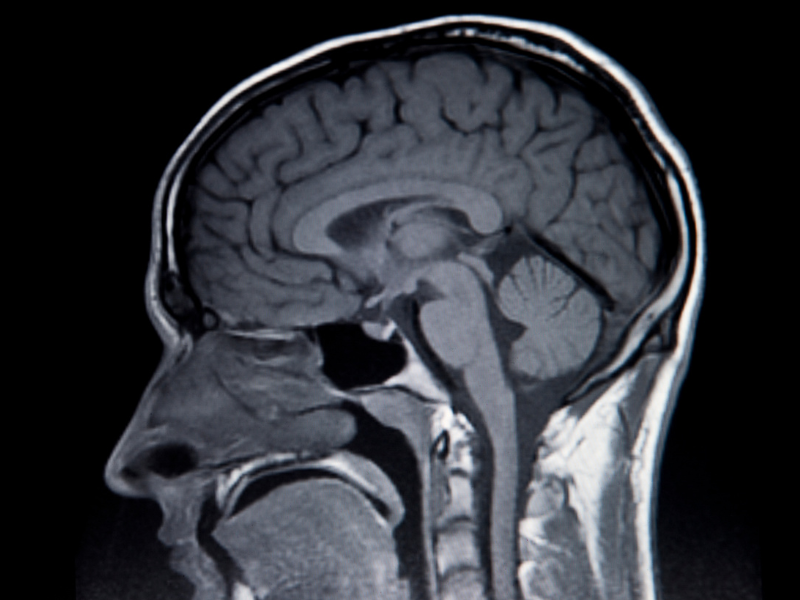

Cinco años después del inicio de sus síntomas, el participante se sometió a una cirugía para insertarle 256 electrodos de silicio, cada uno de 1,5 mm de longitud, en una región del cerebro que controla el movimiento. Maitreyee Wairagkar, neurocientífica de la Universidad de California en Davis y coautora del estudio, y sus colegas entrenaron algoritmos de aprendizaje profundo para capturar las señales cerebrales del hombre cada 10 milisegundos.

Su sistema decodifica, en tiempo real, los sonidos que el hombre intenta producir, en lugar de las palabras que pretende pronunciar o los fonemas constituyentes (las subunidades del habla que forman las palabras habladas).

“No siempre usamos palabras para comunicar lo que queremos. Tenemos interjecciones. Tenemos otras vocalizaciones expresivas que no están en el vocabulario”, explica Wairagkar. “Para lograrlo, hemos adoptado este enfoque, que es completamente ilimitado”.

Un cambio de paradigma

El equipo también personalizó la voz sintética para que sonara como la del hombre, entrenando algoritmos de IA con grabaciones de entrevistas que había realizado antes del inicio de su enfermedad.

Pidieron al participante que intentara hacer interjecciones como “aah”, “ooh” y “hmm” y que dijera palabras inventadas. La BCI produjo estos sonidos con éxito, demostrando que podía generar habla sin necesidad de un vocabulario fijo.

Usando el dispositivo, el participante deletreó palabras, respondió a preguntas abiertas y dijo lo que quería, usando algunas palabras que no formaban parte de los datos de entrenamiento del decodificador. Comentó a los investigadores que escuchar la voz sintética producir su habla lo hacía “sentir feliz” y que la sentía como su “voz real”.

En otros experimentos, la BCI identificó si el participante intentaba decir una oración como una pregunta o como una afirmación. El sistema también pudo determinar cuándo enfatizaba diferentes palabras en la misma oración y ajustar el tono de su voz sintética en consecuencia. “Estamos incorporando todos estos elementos del habla humana que son realmente importantes”, afirma Wairagkar. Las BCI anteriores solo podían producir un habla plana y monótona.

“Esto supone un cambio de paradigma, ya que realmente puede dar lugar a una herramienta práctica“, afirma Silvia Marchesotti, neuroingeniera de la Universidad de Ginebra (Suiza). Las características del sistema “serían cruciales para su adopción para el uso diario por parte de los pacientes en el futuro”.